蚂蚁集团百灵大模型系列迎来重要更新,万亿级大模型 Ling-2.6-1T 正式开源。该模型由 InclusionAI 发布,定位为面向真实复杂任务的综合旗舰模型,重点优化推理效率、Token开销和智能体任务能力,适合代码生成、缺陷修复、多步工具调用、企业级Agent工作流和日常复杂任务处理。官方模型页显示,Ling-2.6-1T 已在 Hugging Face 上开源,模型规模为 1T 参数,并采用 MIT License。

与普通对话模型不同,Ling-2.6-1T 更强调“智效比”。它不仅关注模型回答质量,也关注推理速度、显存占用、Token消耗和复杂任务执行稳定性。这一点对于企业AI应用和智能体产品非常关键,因为真实业务场景中,模型不仅要回答问题,还要能连续执行任务、调用工具、修复代码、遵循复杂约束,并尽可能降低调用成本。

Ling-2.6-1T是什么?

Ling-2.6-1T 是蚂蚁百灵大模型系列中的万亿级开源模型,面向复杂任务和生产级智能体场景设计。官方介绍中明确提到,该模型针对真实复杂场景进行了优化,在推理效率、Token开销和Agent能力方面进行了重点增强,尤其适合编码任务和日常工作流。

简单来说,Ling-2.6-1T 并不是只为聊天问答而生,而是更偏向“能干活”的大模型。它既可以处理代码生成、Bug修复、复杂推理、指令遵循,也可以在多工具、多步骤、多约束的企业工作流中承担智能体底座角色。

对于开发者来说,Ling-2.6-1T 的开源意味着可以获得一个面向Agent应用优化的万亿级模型选择。对于企业来说,它则提供了构建内部AI研发助手、自动化办公助手、知识库Agent和生产级任务执行系统的新底座。

万亿级参数带来更强综合能力

Ling-2.6-1T 的模型规模达到 1T 参数。大参数规模通常意味着模型具备更强的知识容量、表达能力和复杂任务处理潜力。尤其在代码、推理、长上下文和Agent任务中,大模型需要在大量上下文信息中保持逻辑一致,并持续遵循用户目标。

不过,万亿级模型真正落地并不只看参数规模。如果推理成本过高、响应速度过慢、Token消耗过大,即使模型能力强,也很难在真实业务中大规模使用。

Ling-2.6-1T 的重点就在于,它不仅做大模型能力,也重点做效率优化。官方介绍中提到,该模型通过混合架构降低长上下文场景下的延迟和显存占用,在保证表达能力的同时提升吞吐和降低每Token计算成本。

混合架构:MLA + Linear Attention提升推理效率

Ling-2.6-1T 的核心亮点之一,是采用 MLA 与 Linear Attention 结合的混合架构。这一设计主要用于提升长上下文和复杂任务场景下的推理效率。

在大模型实际使用中,长上下文会带来更高的计算和显存压力。用户输入的文档越长、任务链路越复杂、工具调用轮次越多,模型就越容易面临延迟增加和成本上升的问题。

Ling-2.6-1T 通过混合注意力架构,试图在长上下文处理能力和推理效率之间取得更好的平衡。对开发者来说,这意味着模型在复杂任务中可以更快响应;对企业用户来说,则意味着在大规模调用中有机会获得更好的成本控制。

Fast Thinking快思考机制:减少冗余输出,提高Token效率

Ling-2.6-1T 的另一个关键升级,是引入 Fast Thinking快思考机制。官方介绍中提到,模型在后训练阶段引入了 Contextual Process Redundancy Suppression 奖励策略,用于减少对冗长思维链输出的依赖,让模型能够更直接地给出答案,并压缩输出成本。

这对真实业务非常重要。很多Agent应用成本高,并不是因为单次请求很贵,而是因为模型在多步任务中输出过长、重复解释过多、工具调用链路冗余,最终造成Token消耗放大。

Fast Thinking机制的价值在于,让模型在保持智能水平的同时,减少不必要的冗余表达。对于代码修复、工具调用、任务规划和企业流程自动化来说,更短、更准、更直接的输出,往往比长篇解释更实用。

强化多步任务执行,适合复杂Agent工作流

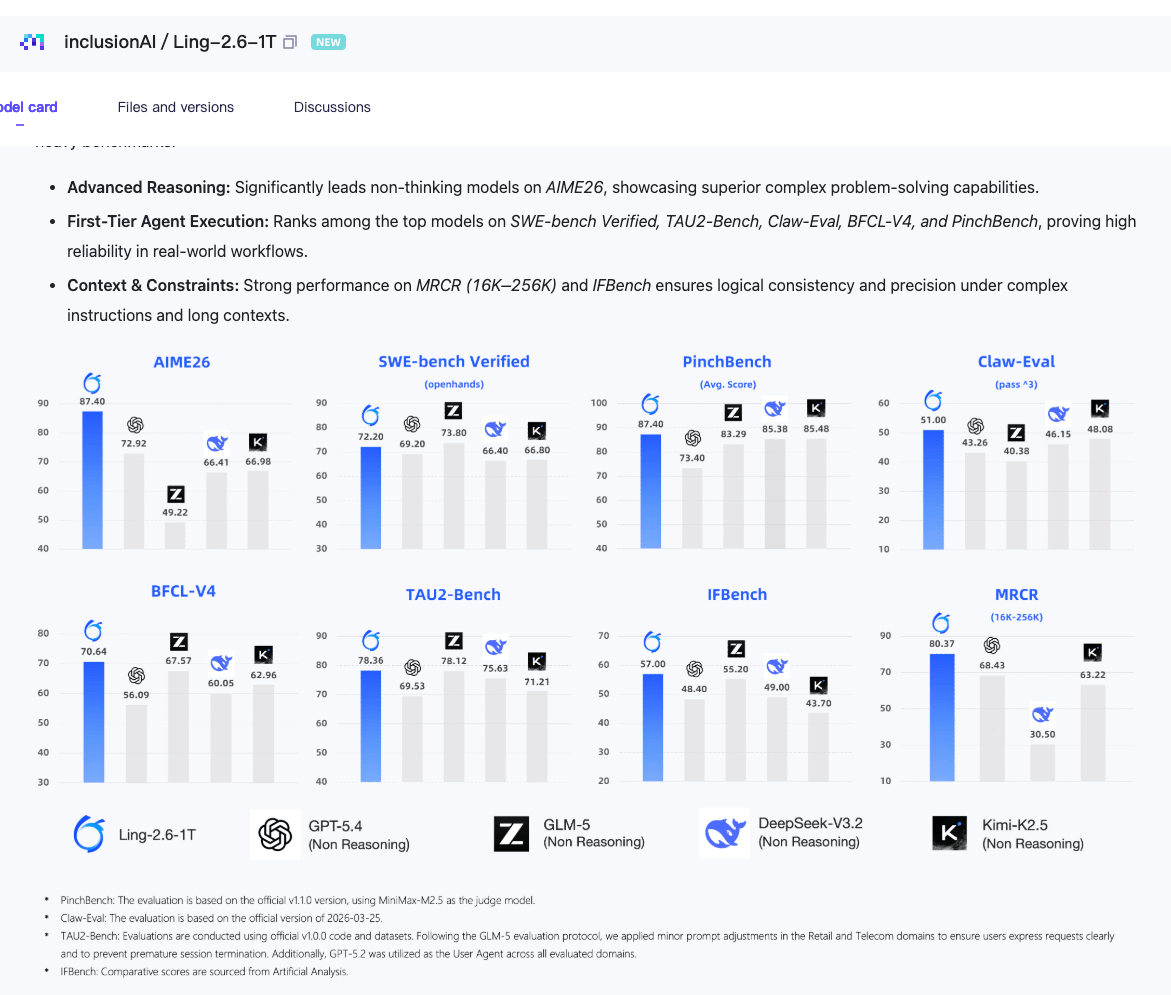

Ling-2.6-1T 面向Agent场景进行了专项强化。官方模型页提到,该模型在推理、Agentic Coding 和指令遵循方面增强,并在 AIME26、SWE-bench Verified、BFCL-V4、TAU2-Bench、IFBench 等执行密集型基准中取得开源SOTA级表现。

Agent任务和普通聊天任务有很大不同。普通聊天只需要回答问题,而Agent任务需要模型理解目标、拆分步骤、调用工具、处理异常、持续跟进,并最终完成任务交付。

例如,一个代码修复Agent可能需要完成以下流程:

读取报错信息

定位相关代码文件

分析近期变更

生成修复代码

运行测试

根据测试结果再次修改

输出修复说明

这类任务需要模型在多轮过程中保持稳定执行能力。Ling-2.6-1T 强化多步任务执行,正是为了适应这类真实生产场景。

代码生成与缺陷修复能力增强

Ling-2.6-1T 被官方明确定位为适合端到端工程任务的模型,覆盖从代码生成到Bug修复的场景,并可与主流Agent框架集成。官方模型页提到,Ling-2.6-1T 可与 Claude Code、OpenClaw、OpenCode、CodeBuddy 等主流Agent框架配合,处理企业环境中的多工具、多步骤约束任务。

这说明 Ling-2.6-1T 不只是能写代码片段,而是更适合进入完整研发工作流。

在实际应用中,它可以用于:

代码生成

代码解释

Bug定位

缺陷修复

测试用例生成

代码审查

工程任务拆解

自动化研发Agent

技术文档生成

项目级代码理解

对于软件团队来说,这类能力可以帮助减少重复性排查工作,提升研发效率。

全栈兼容,助力企业生产工作流落地

一个大模型能否真正进入企业生产环境,除了模型能力本身,还取决于部署方式、框架兼容性、推理引擎支持和工具链适配。

Ling-2.6-1T 官方模型页提供了 SGLang 和 vLLM 相关部署说明,并给出了API调用示例。这对企业和开发者非常重要,因为很多团队希望将模型接入现有推理框架,而不是从零构建部署体系。

全栈兼容的价值在于降低落地门槛。企业可以根据自身GPU资源、推理框架、任务负载和成本预算,选择更合适的部署方式。对于需要私有化部署、内部代码分析、企业知识库和自动化工作流的团队来说,Ling-2.6-1T 的开源和框架兼容性提供了更多可操作空间。

Ling-2.6-1T适合哪些应用场景?

1. AI编程助手

Ling-2.6-1T 适合用于代码生成、代码补全、代码解释、单元测试生成和项目理解。它不仅能生成代码,还能结合上下文进行复杂工程任务处理。

2. 自动代码修复

在缺陷修复场景中,Ling-2.6-1T 可以帮助分析错误日志、定位问题代码、生成修复方案,并辅助测试验证。对于研发团队来说,这可以减少重复排查时间。

3. 企业级Agent工作流

Ling-2.6-1T 适合构建企业内部Agent,例如研发Agent、数据分析Agent、文档处理Agent、客服Agent和自动化办公Agent。它的多步执行能力和工具调用能力,可以支撑更复杂任务。

4. 工具调用与多步骤任务

模型在BFCL-V4、TAU2-Bench等工具调用相关任务中表现突出,适合需要调用多个外部工具、API或系统的场景。

5. 长上下文复杂任务

通过混合架构优化长上下文场景的推理效率,Ling-2.6-1T 适合处理长文档、长代码库、复杂资料检索和多轮上下文任务。

6. 企业私有化部署

由于模型已开源,并提供部署说明,企业可以根据自身数据安全和算力资源需求,评估私有化部署或内部模型服务方案。

与Ling-2.6-flash相比有什么不同?

此前蚂蚁百灵系列已经开源 Ling-2.6-flash。相比之下,Ling-2.6-flash 更强调轻量、高速和高Token效率,适合高频调用和日常Agent任务;而 Ling-2.6-1T 则是更强的万亿级旗舰模型,面向复杂任务、代码修复、高难度推理和生产级工作流。

简单理解:

Ling-2.6-flash 适合高频、快速、低成本场景。

Ling-2.6-1T 适合复杂、高质量、多步骤任务场景。

两者可以形成互补。开发者可以在日常轻量任务中使用flash版本,在高难度任务、复杂代码修复和企业级Agent流程中选择1T版本。

对开发者有什么价值?

Ling-2.6-1T 的开源,为开发者带来了三个直接价值。

第一,提供了万亿级开源模型选择。开发者可以测试更强模型在复杂任务中的表现,而不完全依赖闭源服务。

第二,适合Agent产品开发。模型针对工具调用、多步执行、代码任务和企业工作流进行了优化,适合构建智能体应用。

第三,部署路径更清晰。官方提供了SGLang、vLLM等部署说明,方便开发者将模型接入已有推理系统。

对于正在开发AI编程工具、研发Agent、企业工作流平台和自动化任务系统的团队来说,Ling-2.6-1T 是值得重点关注的模型底座。

对企业用户有什么意义?

企业使用大模型时,往往关注四件事:能力、成本、稳定性和可控性。

Ling-2.6-1T 通过万亿级模型能力提供更强复杂任务处理能力;通过混合架构和Fast Thinking机制提升效率;通过开源和主流推理框架兼容,增强部署可控性;通过Agent任务优化,更适合企业生产工作流。

对于研发团队来说,它可以帮助处理代码修复、测试验证、代码审查和文档生成。

对于运营团队来说,它可以参与复杂资料处理和自动化流程。

对于企业知识管理来说,它可以接入内部文档与工具,形成更强的知识Agent。

这使得Ling-2.6-1T不只是一个模型,而是企业构建智能生产力系统的重要基础组件。

开源万亿级模型对行业有什么影响?

Ling-2.6-1T 的开源,进一步丰富了国产开源大模型生态。过去,万亿级模型通常更容易以闭源API形式出现,开发者很难直接研究、部署和改造。Ling-2.6-1T 开源后,开发者可以更近距离观察万亿级模型在Agent任务、代码任务和复杂工作流中的表现。

这对行业有几方面意义。

第一,推动开源模型能力上限继续提升。

第二,促进Agent应用从演示走向生产。

第三,降低企业探索大模型私有化的门槛。

第四,推动代码生成和缺陷修复进入更自动化阶段。

第五,为国内开发者提供更多可选模型底座。

随着更多模型开源,未来企业选择AI底座时,不再只看参数规模,而会更加关注智效比、推理成本、部署难度和任务完成率。

使用建议

如果你是个人开发者,可以先通过 Hugging Face 或 ModelScope 查看模型说明,了解模型能力、部署要求和使用方式。

如果你是企业团队,建议结合自身场景进行专项测试,例如代码修复、工具调用、长文档处理、自动化流程和内部知识库任务。

如果你正在做AI Agent产品,可以重点测试Ling-2.6-1T在多步任务执行、错误恢复、指令遵循和Token效率方面的表现。

由于万亿级模型对硬件和推理系统要求较高,正式部署前建议充分评估算力成本、吞吐能力、延迟表现和任务收益。

总结

蚂蚁集团正式开源万亿级大模型 Ling-2.6-1T,为开发者和企业用户提供了一个面向复杂任务、代码生成、缺陷修复和Agent工作流优化的强大模型选择。该模型通过 MLA 与 Linear Attention 混合架构提升推理效率,通过 Fast Thinking 快思考机制减少冗余Token输出,并通过多步任务训练增强工具调用和复杂任务执行稳定性。

从应用价值来看,Ling-2.6-1T 不只是一个聊天模型,更适合作为企业AI工作流、研发Agent、自动代码修复系统和复杂任务执行平台的模型底座。对于希望构建高质量AI生产力工具的开发者来说,Ling-2.6-1T 的开源值得重点关注。

官网链接

Hugging Face:Ling-2.6-1T

ModelScope:Ling-2.6-1T

文章标题:蚂蚁集团开源万亿级大模型 Ling-2.6-1T:混合架构提升智效比,强化代码生成与Agent任务执行

文章链接:https://www.prosaas.cn/35215.html

更新时间:2026年05月11日

声明: 本站大部分内容均收集于网络!若内容若侵犯到您的权益,请发送邮件至:973664285@qq.com我们将第一时间处理! 资源所需价格并非资源售卖价格,是收集、整理、编辑详情以及本站运营的适当补贴,并且本站不提供任何免费技术支持。 所有资源仅限于参考和学习,版权归原作者所有,更多请阅读知企PROSAAS协议